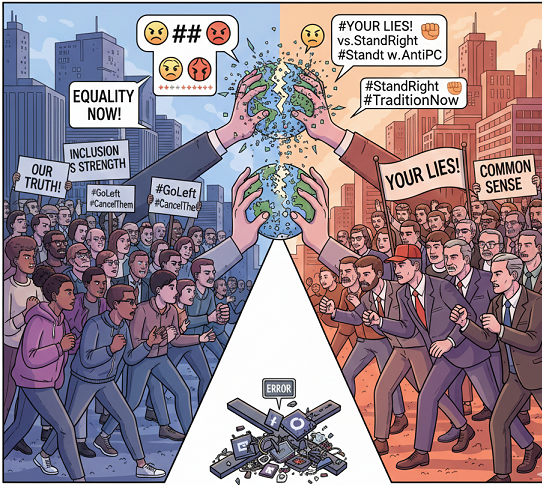

Transformasi radikal dalam ekosistem informasi global selama dekade terakhir (2015–2025) telah menggeser paradigma komunikasi manusia dari keterbukaan akses menjadi fragmentasi yang terstruktur secara algoritmik. Platform media sosial kontemporer seperti Instagram, TikTok, YouTube, dan X bukan lagi sekadar infrastruktur pasif bagi pertukaran data, melainkan entitas aktif yang membentuk realitas subjektif penggunanya melalui sistem pemberi rekomendasi yang sangat kompleks. Dalam lanskap ini, algoritma bertindak sebagai kurator realitas yang memprioritaskan keterlibatan emosional di atas akurasi faktual, yang secara sistematis memperkuat sikap ekstrem dan mengikis kapasitas masyarakat untuk melakukan dialog lintas kelompok. Arsitektur platform ini menggunakan sistem integrasi berbasis graf hierarkis dan kecerdasan buatan untuk menangkap pola semantik serta sintaksis yang tersembunyi, yang kemudian digunakan untuk memprediksi dan menyajikan konten yang paling selaras dengan perilaku pengguna masa lalu, sehingga menciptakan lingkungan informasi yang terfragmentasi dan memperkuat keyakinan yang sudah ada.

Mekanisme Teknis Isolasi Informasi: Dekonstruksi Filter Bubbles dan Echo Chambers

Untuk memahami bagaimana polarisasi diperkuat, sangat krusial bagi para analis untuk membedakan secara rigid antara dua mekanisme isolasi informasi yang sering kali dikelirukan: filter bubbles dan echo chambers. Gelembung filter (filter bubble) merupakan konsekuensi langsung dari personalisasi algoritmik di mana sistem secara otomatis menyaring informasi yang tidak sesuai dengan profil minat pengguna, sehingga membatasi paparan terhadap perspektif yang beragam secara pasif. Di sisi lain, ruang gema (echo chamber) muncul melalui dinamika sosial aktif dan bias konfirmasi, di mana individu secara sengaja memilih untuk berinteraksi hanya dengan kelompok yang berpikiran serupa, sehingga memperkuat suara internal dan memarginalkan opini yang berbeda.

Analisis mendalam terhadap struktur epistemic sosial menunjukkan bahwa ruang gema sering kali berfungsi sebagai struktur yang menindas secara sengaja, di mana suara-suara luar bukan hanya diabaikan tetapi secara aktif didiskreditkan untuk meningkatkan konsensus komunitas. Hal ini menciptakan isolasi yang didasarkan pada manajemen kepercayaan yang aktif untuk memisahkan kelompok dari perspektif lawan. Algoritma memperparah kondisi ini dengan memprioritaskan informasi yang bersifat “PRIME”—yaitu konten yang Prestigious (bergengsi), Ingroup (selaras dengan kelompok), Moral, dan Emotional (emosional)—yang secara langsung menyasar identitas sosial individu dan memperkuat promosi selektif.

| Dimensi Perbedaan | Filter Bubble (Gelembung Filter) | Echo Chamber (Ruang Gema) |

| Penyebab Utama | Algoritma Rekomendasi (Teknis) | Bias Konfirmasi & Homofili (Sosial) |

| Karakteristik | Pasif, tidak terlihat oleh pengguna | Aktif, berbasis pada manajemen kepercayaan |

| Dampak Kognitif | Penyempitan akses informasi | Penguatan identitas dan permusuhan kelompok |

| Format Dominan | Feed yang dipersonalisasi (FYP, For You) | Grup tertutup (WhatsApp, Reddit, FB Groups) |

| Intervensi Utama | Perubahan desain sistem/algoritma | Literasi media & inokulasi psikologis |

Fenomena ini berakar pada kecenderungan manusia untuk menghindari disonansi kognitif yang muncul saat berhadapan dengan keyakinan yang kontradiktif. Platform digital mengeksploitasi homofili digital ini melalui algoritma yang memunculkan konten berdasarkan keterlibatan pengguna sebelumnya, yang secara sistematis membatasi paparan terhadap sudut pandang lawan. Polarisasi jaringan terjadi ketika komunitas menjadi sangat terhubung secara internal namun memiliki konektivitas antar-kelompok yang sangat lemah, yang dapat diukur melalui metrik seperti modularitas dan random walks dalam graf jaringan.

Ekonomi Emosional dan Komodifikasi Perhatian

Algoritma media sosial modern beroperasi dalam kerangka “ekonomi emosional” di mana perhatian pengguna adalah komoditas yang paling berharga. Untuk memaksimalkan waktu retensi, platform merancang algoritma yang memprioritaskan konten dengan tingkat keterlibatan tinggi, yang sering kali identik dengan konten yang memicu reaksi emosional kuat seperti kemarahan, kejutan, atau inspirasi ekstrem. Konten yang bersifat tenang, stabil, dan biasa saja cenderung memiliki performa buruk dalam sistem yang digerakkan oleh algoritma ini, sehingga suara-suara moderat sering kali tenggelam oleh kebisingan konten yang sensasional.

Data statistik tahun 2025 menunjukkan dampak nyata dari prioritas keterlibatan ini terhadap penyebaran informasi dan pembentukan opini publik. Ketidakseimbangan antara visibilitas konten akurat dan konten sensasional menciptakan distorsi dalam persepsi realitas pengguna.

| Platform | Metrik Algoritmik & Dampak Informasi | Statistik Dampak (2025) |

| X (Twitter) | Kecepatan penyebaran berita palsu vs berita benar | Berita palsu menyebar 20x lebih cepat |

| Promosi sumber misinformasi dibandingkan sumber faktual | 64% lebih tinggi untuk misinformasi | |

| YouTube | Proporsi durasi tontonan dari mesin rekomendasi | ~70% dari total waktu tonton |

| TikTok | Probabilitas konten misinformasi untuk menjadi viral | 15% kemungkinan viralitas tinggi |

| Umum | Pengguna harian yang terpapar feed personalisasi | >5.4 Miliar orang |

Dinamika ini mendorong apa yang disebut sebagai “radikalisasi algoritmik,” di mana sistem secara bertahap menyarankan konten yang semakin ekstrem untuk mempertahankan ketertarikan pengguna. Hal ini juga menciptakan fenomena doomscrolling, di mana pengguna secara kompulsif menggulir konten berita buruk yang pada gilirannya memperkuat kecemasan, ketakutan, dan depresi. Algoritma menciptakan loop penguatan yang mempromosikan konten yang memicu perbandingan sosial dan penurunan harga diri, terutama di kalangan remaja dan dewasa muda yang menghabiskan waktu lebih dari dua jam setiap hari di platform tersebut.

Psikologi Polarisasi: Identitas Sosial dan Bias Kognitif

Polarisasi politik bukan sekadar fenomena teknis, melainkan manifestasi dari proses psikologis yang mendalam. Teori Identitas Sosial yang dikembangkan oleh Tajfel dan Turner menjelaskan bagaimana individu cenderung mengelompokkan diri ke dalam kategori sosial untuk membangun rasa memiliki, yang sering kali berujung pada favoritisme kelompok sendiri (in-group) dan diskriminasi terhadap kelompok lain (out-group). Algoritma mengeksploitasi mekanisme ini dengan menyajikan isyarat partisan (partisan cues)—seperti simbol, frasa, atau dukungan tokoh—yang memungkinkan pengguna menyelaraskan diri dengan kelompok mereka tanpa harus mengevaluasi detail informasi secara kritis.

Bias konfirmasi bertindak sebagai filter internal yang membuat individu hanya mencari dan mengingat informasi yang mendukung keyakinan mereka, sementara pengabaian aktif terhadap fakta yang kontradiktif memperkuat polarisasi. Dalam konteks politik, terdapat pergeseran dari model partisipasi instrumental—di mana pemilih membuat keputusan logis berdasarkan kebijakan—menuju model ekspresif, di mana pilihan politik didasarkan pada identitas sosial seperti agama, ras, atau gender. Hal ini menjelaskan mengapa stabilitas partisan tetap tinggi meskipun terdapat kegagalan kebijakan atau pergeseran ekonomi, karena pemilih lebih memprioritaskan perlindungan terhadap identitas kelompok mereka daripada efisiensi pemerintahan.

Konsekuensi psikologis dari lingkungan yang terpolarisasi ini mencakup:

- Polarisasi Afektif:Munculnya ketidaksukaan mendalam dan kebencian terhadap pendukung partai lawan, melampaui perbedaan pendapat mengenai kebijakan.

- Polarisasi Palsu:Persepsi yang berlebihan mengenai sejauh mana perbedaan ideologi antara kelompok, yang sering kali diperkuat oleh politisi dan media untuk menciptakan basis pemilih yang stabil.

- Penalaran Termotivasi:Interpretasi informasi dengan cara yang melindungi investasi emosional atau identitas kelompok, bahkan ketika dihadapkan pada bukti objektif yang kuat.

- Efek Kebenaran Ilusi:Pernyataan yang diulang-ulang secara terus-menerus dalam ruang gema cenderung dianggap lebih benar karena kemudahan pemrosesan kognitif.

Penelitian menunjukkan bahwa orang tidak hanya menyukai informasi yang selaras dengan keyakinan mereka, tetapi tetap mempertahankan keyakinan tersebut meskipun bukti pendukung aslinya telah dibuktikan salah. Hal ini menciptakan tantangan besar bagi upaya moderasi konten dan pengecekan fakta, karena koreksi informasi sering kali gagal diinternalisasi ke dalam memori jika bertentangan dengan identitas kelompok yang kuat.

Ancaman AI Generatif Terhadap Pilar Demokrasi

Kehadiran teknologi kecerdasan buatan generatif (GenAI) telah memperkenalkan lapisan risiko baru yang mengancam tiga pilar utama demokrasi: representasi, akuntabilitas, dan kepercayaan. Kemampuan AI untuk memproduksi konten mesin dalam volume masif yang menyerupai komunikasi manusia memungkinkan aktor jahat untuk membanjiri lanskap media dengan disinformasi yang sangat persuasif.

Ancaman Terhadap Representasi dan Akuntabilitas

Demokrasi menuntut pemerintah untuk responsif terhadap preferensi warga, namun GenAI mengikis kapasitas pejabat untuk membedakan sentimen konstituen yang asli dari pesan advokasi yang dihasilkan oleh AI secara massal. Sebuah eksperimen lapangan pada tahun 2020 menunjukkan bahwa legislator negara bagian sering kali tidak dapat membedakan antara email yang ditulis oleh manusia dan email yang dihasilkan oleh AI, yang memungkinkan aktor tertentu untuk membelokkan persepsi legislator mengenai isu-isu penting di distrik mereka. Selain itu, proses pembuatan aturan publik (rulemaking) dapat menjadi usang jika platform komentar publik dibanjiri oleh ribuan komentar unik yang dihasilkan AI, sebuah praktik “astroturfing” yang kini jauh lebih sulit dideteksi dibandingkan metode duplikasi sederhana di masa lalu.

Erosi Kepercayaan dan “Liar’s Dividend”

Kepercayaan adalah mata uang paling krusial dalam sistem politik. Banjir “sampah informasi” yang dihasilkan AI menciptakan lingkungan di mana respons kognitif yang paling masuk akal bagi warga adalah tidak mempercayai apa pun—sebuah bentuk nihilisme informasi yang merusak kohesi sosial. Fenomena “Liar’s Dividend” (keuntungan bagi pembohong) juga muncul, di mana aktor politik dapat menolak bukti nyata dari skandal atau perilaku buruk dengan klaim bahwa bukti tersebut adalah “rekayasa AI,” sehingga semakin mengaburkan batas antara realitas dan manipulasi.

| Risiko AI Generatif | Deskripsi Mekanisme | Dampak Demokratis |

| Disinformasi Skala Besar | Produksi teks, audio, dan deepfake berkualitas tinggi dengan biaya rendah. | Pemilih kehilangan akses ke informasi akurat untuk akuntabilitas. |

| Manipulasi Sentimen | Penggunaan bot AI untuk membanjiri ruang publik dengan opini palsu. | Pejabat salah menafsirkan kehendak rakyat (distorsi representasi). |

| Nihilisme Informasi | Kondisi di mana warga berhenti mempercayai semua sumber berita. | Penurunan partisipasi politik dan kepercayaan pada institusi. |

| Polarisasi Algoritmik | Penargetan mikro yang sangat spesifik berdasarkan data perilaku. | Penajaman perpecahan “Us vs. Them” melalui narasi yang dipersonalisasi. |

Krisis Kepercayaan Global: Analisis Trust Barometer 2025

Laporan Edelman Trust Barometer 2025 mengungkapkan pergeseran fundamental dalam psikologi massa global yang disebut sebagai “Krisis Keluhan” (Crisis of Grievance). Data dari 28 negara menunjukkan bahwa ketakutan ekonomi telah bermetastasis menjadi rasa keluhan yang mendalam, di mana mayoritas responden percaya bahwa sistem saat ini hanya menguntungkan orang kaya sementara masyarakat umum berjuang untuk bertahan hidup. Sebanyak 61% responden global memiliki rasa keluhan yang moderat hingga tinggi, yang secara langsung berkorelasi dengan ketidakpercayaan terhadap empat institusi utama: bisnis, pemerintah, media, dan LSM.

Kesenjangan kepercayaan yang mencolok terjadi antara kelompok berpendapatan tinggi dan rendah, menciptakan “ketimpangan kepercayaan” yang membahayakan stabilitas sosial. Di Amerika Serikat, terdapat perbedaan 18 poin dalam indeks kepercayaan antara kuartil pendapatan atas dan bawah, di mana kelompok berpendapatan rendah berada dalam kondisi “terperosok dalam ketidakpercayaan”. Kondisi ini diperparah oleh hilangnya optimisme terhadap generasi mendatang, di mana hanya 36% responden yang percaya bahwa masa depan akan lebih baik.

Ketidakpercayaan ini mendorong penerimaan terhadap tindakan-tindakan agresif. Sebanyak 40% responden (dan 53% di kalangan usia 18-34 tahun) menyetujui setidaknya satu bentuk aktivisme bermusuhan, termasuk menyerang orang secara daring, menyebarkan disinformasi secara sengaja, atau bahkan kekerasan fisik dan pengrusakan properti. Mentalitas “zero-sum” ini, di mana keuntungan kelompok lawan dianggap sebagai kerugian mutlak bagi kelompok sendiri, dua kali lebih umum di kalangan individu dengan rasa keluhan tinggi.

| Statistik Kepercayaan Global 2025 | Persentase / Skor | Konteks Data |

| Indeks Kepercayaan (Global) | 56 | Rata-rata kepercayaan pada 4 institusi utama |

| Rasa Keluhan Tinggi/Moderat | 61% | Keyakinan sistem merugikan rakyat biasa |

| Optimisme Masa Depan Anak Cucu | 36% | Terendah di negara maju (Prancis 9%, UK 17%) |

| Kekhawatiran Misleading Info | 69% | Percaya pemimpin sengaja menyesatkan publik |

| Hardship Finansial (Usia <45) | 68% | Kesulitan membayar tagihan atau kebutuhan dasar |

| Persetujuan Hostile Activism | 40% | Termasuk disinformasi sengaja dan kekerasan |

Sumber: Edelman Trust Barometer 2025

Erosi kepercayaan ini juga berdampak pada otoritas informasi. Individu dengan rasa keluhan tinggi lebih menghargai “kasih sayang” dan pemahaman terhadap kebutuhan rakyat kecil (78%) dibandingkan posisi kekuasaan formal (37%) sebagai dasar legitimasi seorang ahli atau pemimpin. Hal ini menciptakan celah bagi pemimpin populis dan pengaruh media sosial untuk menggantikan peran institusi tradisional dalam membentuk opini publik.

Dinamika Polarisasi dan Algoritma di Indonesia

Dalam konteks Indonesia, pengaruh algoritma terhadap polarisasi politik dan sosial memiliki karakteristik unik yang dipengaruhi oleh struktur sosiokultural lokal. Penggunaan platform media sosial secara masif selama siklus politik 2014, 2019, dan 2024 telah menunjukkan bagaimana narasi digital dapat memicu konflik horizontal dan kekerasan di dunia nyata. Algoritma TikTok, khususnya, telah menjadi perhatian utama karena kemampuannya mendorong konten provokatif dan partisan untuk menjadi viral dalam waktu singkat melalui logika feed berbasis kecepatan (velocity-based logic).

Penelitian mengenai penggunaan TikTok di Indonesia menunjukkan bahwa algoritma rekomendasi secara aktif mengatur distribusi konten politik yang sering kali memperbesar ruang gema dan mempercepat penyebaran disinformasi berbasis SARA (Suku, Agama, Ras, dan Antargolongan). Analisis terhadap tagihan (hashtag) di X mengungkapkan bahwa isu-isu keagamaan menjadi pemicu utama perselisihan netizen, dengan narasi seputar intoleransi, politik identitas, dan radikalisme mendominasi percakapan menjelang Pemilu 2024.

| Isu Keagamaan di X Indonesia (2023) | Jumlah Cuitan | Persentase (%) |

| #Salafi | 6,596 | 28.15% |

| #Wahabi | 4,952 | 21.13% |

| #Intoleransi | 2,300 | 9.82% |

| #Komunisme | 2,260 | 9.64% |

| #AntiPancasila | 1,979 | 9.45% |

| #PolitisasiAgama | 1,260 | 5.38% |

| #PolitikIdentitas | 960 | 4.10% |

Sumber: Analisis crawling data Twitter/X periode Juli-Oktober 2023

Meskipun terdapat polarisasi yang tajam di ruang digital, kepercayaan terhadap institusi tertentu di Indonesia menunjukkan ketahanan yang mengejutkan. Tentara Nasional Indonesia (TNI) tetap menjadi lembaga yang paling dipercaya oleh masyarakat dengan tingkat kepercayaan mencapai 94,6% pada tahun 2025. Kepercayaan terhadap Presiden (Prabowo Subianto) juga tercatat tinggi pada angka 88% di awal tahun 2025, mencerminkan harapan besar publik di tengah krisis kepercayaan global. Namun, tantangan tetap ada pada lembaga penegak hukum seperti Kepolisian (Polri) yang memiliki tingkat kepercayaan relatif lebih rendah (65%) dibandingkan lembaga lainnya. Ketidakpuasan juga mulai muncul di tingkat akar rumput akibat kebijakan ekonomi seperti kenaikan pajak dan persepsi tentang meningkatnya peran militer dalam ranah sipil, yang memicu gelombang protes jalanan pada Agustus 2025.

Strategi Mitigasi: Regulasi, Teknologi, dan Literasi

Upaya global untuk menanggulangi dampak negatif algoritma terhadap polarisasi telah melahirkan berbagai inisiatif hukum dan teknis. Uni Eropa berada di garis depan dengan Digital Services Act (DSA) dan AI Act, yang menetapkan kerangka kerja untuk transparansi algoritma, akuntabilitas platform, dan manajemen risiko sistemik. Di Inggris, Online Safety Act (OSA) mewajibkan platform untuk mengambil tindakan proaktif terhadap konten berbahaya dan memberikan kontrol lebih besar kepada pengguna atas feed mereka.

Intervensi Teknis: Downranking dan Penguatan Kontrol Pengguna

Eksperimen yang dipimpin oleh Universitas Stanford pada tahun 2025 memberikan bukti kuat bahwa polarisasi dapat dikurangi tanpa harus menghapus konten politik. Dengan menggunakan alat yang menurunkan peringkat (downranking) konten antidemokrasi dan bahasa partisan yang bermusuhan, peneliti menemukan peningkatan signifikan dalam sikap pengguna terhadap partai lawan. Penurunan paparan terhadap konten antagonis ini secara langsung mengurangi perasaan marah dan sedih di kalangan peserta, yang mencakup spektrum liberal maupun konservatif.

Inokulasi Psikologis dan Literasi Media Gamifikasi

Strategi “prebunking” atau inokulasi psikologis telah terbukti efektif dalam membangun ketahanan masyarakat terhadap disinformasi. Pendekatan ini bekerja seperti vaksin, di mana individu diberikan paparan lemah terhadap taktik manipulasi informasi diikuti oleh sanggahan yang kuat, sehingga mereka dapat mengenali penipuan di masa depan. Di Indonesia, studi tentang intervensi literasi media tergamifikasi “Gali Fakta” menunjukkan peningkatan motivasi yang berkelanjutan di kalangan peserta untuk mendeteksi dan memerangi informasi palsu.

| Jenis Intervensi | Mekanisme Utama | Hasil Penelitian (2024-2025) |

| Algorithmic Downranking | Menurunkan visibilitas konten ekstrem tanpa penghapusan. | Perbaikan sikap terhadap oposisi (rata-rata 2 poin skala 1-100). |

| Prebunking (Visual) | Iklan visual yang menjelaskan taktik misinformasi. | Peningkatan skor literasi informasi yang signifikan (x̄ = 0.93 vs 0.33 control). |

| Gamified Literacy (Gali Fakta) | Simulasi grup chat (WhatsApp style) untuk edukasi taktik hoaks. | Peningkatan motivasi dan normalisasi sosial untuk deteksi hoaks. |

| AI Labeling (India) | Mandat label transparan pada 10% konten visual/audio AI. | Menekankan transparansi di atas larangan, meski efektivitas psikologis masih diuji. |

Sumber: Disintesis dari hasil penelitian Stanford, Gali Fakta, dan studi inokulasi

Tata Kelola AI di Asia Tenggara

ASEAN telah mengambil langkah proaktif dengan merilis “ASEAN Guide on AI Governance and Ethics” yang diperluas untuk mencakup AI generatif pada tahun 2025. Pedoman ini menekankan prinsip transparansi, keadilan, dan keamanan, serta mendorong tanggung jawab bersama di antara pengembang, penyebar, dan regulator. Meskipun pedoman ini masih bersifat tingkat tinggi dan kurang dalam detail penegakan hukum praktis, ia berfungsi sebagai kompas kebijakan regional untuk menyelaraskan standar etika di tengah keragaman hukum di Asia Tenggara.

Kesimpulan dan Implikasi Strategis

Analisis komprehensif terhadap perilaku polarisasi global menunjukkan bahwa algoritma media sosial telah bertindak sebagai katalisator utama dalam memperdalam perpecahan masyarakat dan mengikis landasan dialog demokratis. Melalui mekanisme personalisasi yang mengeksploitasi bias kognitif dan identitas sosial, platform digital secara sistematis menciptakan lingkungan informasi yang terfragmentasi di mana ekstremisme dihargai dengan visibilitas tinggi, sementara moderasi sering kali terabaikan.

Kehadiran AI generatif memperumit tantangan ini dengan memberikan alat bagi aktor jahat untuk memanipulasi opini publik dan merusak kepercayaan terhadap realitas objektif. Erosi kepercayaan terhadap institusi, sebagaimana tercermin dalam data Edelman 2025, bukan hanya masalah persepsi tetapi juga ancaman keamanan nasional karena meningkatnya penerimaan terhadap aktivisme bermusuhan dan kekerasan sebagai alat perubahan politik.

Masa depan kohesi sosial bergantung pada transisi dari model algoritma yang murni berbasis keterlibatan menuju arsitektur digital yang memprioritaskan “prosocial media”—yaitu model yang mengutamakan empati, inklusivitas, dan akurasi informasi. Mitigasi yang efektif memerlukan pendekatan berlapis yang menggabungkan regulasi platform yang ketat, inovasi teknis dalam kontrol umpan konten, dan investasi masif dalam ketahanan kognitif masyarakat melalui literasi media. Hanya dengan mengembalikan kontrol atas algoritma kepada kepentingan publik dan etika demokrasi, masyarakat global dapat mulai memulihkan dialog yang terfragmentasi dan membangun kembali kepercayaan institusional yang telah terkikis.